Uwolnić Krakena: prosty sposób na wprowadzenie sztucznej inteligencji do każdego systemu przemysłowego

Istnieje szerokie zainteresowanie wdrażaniem zastosowań wykorzystujących sztuczną inteligencję (AI) i uczenie maszynowe (ML) w środowiskach przemysłowych w celu zwiększenia wydajności i efektywności przy jednoczesnym osiągnięciu oszczędności na kosztach operacyjnych. Jednakże każdy inżynier czy kierownik działu inżynieryjnego wie, że istnieją trzy główne problemy, które należy rozwiązać, zanim doda się człon „inteligentny” do „głupich” maszyn, takich jak silniki czy instalacje HVAC.

Po pierwsze osób z wiedzą na temat AI i ML jest za mało, aby zaspokoić popyt, a usługi dostępnych ekspertów nie są tanie. Po drugie brakuje odpowiednich zestawów danych, za pomocą których można by trenować systemy AI i ML, a wszelkie dostępne zestawy danych są zazdrośnie strzeżone przez ich właścicieli. Po trzecie systemy AI i ML zwykle wymagają wysokiej klasy platform przetwarzania danych, na których można pracować.

Potrzebny jest sposób umożliwiający inżynierom i programistom bez doświadczenia w zakresie AI i ML szybkie tworzenie systemów AI i ML i wdrażanie ich na wydajnych, tanich platformach opartych na mikrokontrolerach. Ciekawy start-up o nazwie Cartesiam.AI, oferujący produkt NanoEdge AI Studio, zajmuje się wszystkimi tymi zagadnieniami. Już wyjaśniamy jak.

Jak rozwija się AI i ML

W zależności od źródła oczekuje się, że do połowy 2020 r., na całym świecie będzie od 20 do 30 miliardów urządzeń brzegowych,1,2 gdzie termin „urządzenie brzegowe” odnosi się do podłączonych urządzeń i czujników umieszczonych na brzegach Internetu, czyli tam gdzie łączy się on ze światem rzeczywistym. Tylko około 0,3% z nich zostanie uzupełnione o możliwości AI i ML. Ponadto szacuje się, że do 2025 r.3,4 liczba takich urządzeń wyniesie od 40 do 75 mld i oczekuje się, że do tego czasu co najmniej 25% z nich będzie musiało być wyposażone w możliwości AI i ML.

Głównym czynnikiem we wdrożeniach przemysłowych jest wykorzystanie istniejących „głupich” maszyn i sprawienie, że będą „inteligentne” poprzez zwiększenie ich możliwości w zakresie AI i ML. Trudno tu przecenić potencjał rynku - na przykład szacuje się, że w samych Stanach Zjednoczonych istnieje „głupia” (starszego typu) infrastruktura i maszyny o wartości 6,8 biliona dolarów.5

Jak sprawić, by AI i ML działały bardziej efektywnie na brzegu

Internet rzeczy (IoT) oraz przemysłowy IoT (IIoT) to zjawiska wszechobecne. Przedmioty już są podłączone do sieci - kolejnym wyzwaniem jest sprawienie, by były „inteligentne”.

Tradycyjny sposób tworzenia zastosowań AI/ML polega na zdefiniowaniu architektury sieci neuronowej, w tym liczby warstw neuronowych, liczby neuronów na warstwę oraz sposobów, w jakie różne neurony i warstwy się łączą. Następnym krokiem jest uzyskanie dostępu do odpowiedniego zestawu danych (którego stworzenie mogło zająć dużo czasu i wymagać wielu zasobów). Zbiór danych jest wykorzystywany do trenowania sieci w chmurze (tj. przy użyciu dużej liczby wysokiej klasy serwerów o kolosalnych możliwościach obliczeniowych). Na koniec, wytrenowaną w ten sposób sieć przekłada się na formę odpowiednią do wdrożenia w urządzeniu końcowym.

Zgodnie z raportem IBM Quant Crunch,6 „data science” i „data analytics” (DSA) nie są już modnymi wyrażeniami, a raczej niezbędnymi narzędziami biznesowymi. Istnieje jednak coraz większa obawa, że podaż osób posiadających umiejętności w zakresie DSA pozostanie niebezpiecznie w tyle za popytem, przy czym w samych Stanach Zjednoczonych liczba osób zajmujących się danymi wynosi obecnie 130 tysięcy.

Niestety, brak dostępu do wykwalifikowanych naukowców i odpowiednich zestawów danych jest przeszkodą w szybkim i przystępnym cenowo tworzeniu inteligentnych obiektów wykorzystujących AI/ML. Według Cisco7 wskaźnik niepowodzeń w realizacji projektów w zakresie Internetu rzeczy wynosi ogólnie około 74%, a w przypadku projektów związanych z AI/ML wskaźnik ten jeszcze wzrasta.

Według IDC8 na świecie jest około 22 milionów twórców oprogramowania. Około 1,2 mln z nich koncentruje się na systemach wbudowanych, a jedynie około 0,2% z nich posiada choć minimalne umiejętności w zakresie AI/ML.

Niektóre systemy AI i ML, takie jak wizyjne systemy komputerowe do wykrywania i identyfikacji obiektów, wymagają użycia specjalnych, wysokiej klasy urządzeń obliczeniowych, w tym procesorów graficznych (GPU) lub bezpośrednio programowalnych macierzy bramek (FPGA). Nowe osiągnięcia w zakresie technologii AI/ML oznaczają jednak, że zdecydowana większość zastosowań AI/ML niezwiązanych z systemami wizyjnymi może być wdrażana na stosunkowo niskiej klasy mikrokontrolerach, które są obecne w systemach wbudowanych.

Według Statisty9 w 2020 r. globalne dostawy mikrokontrolerów mają wynieść około 28 miliardów jednostek (czyli około 885 urządzeń na sekundę), co uczyni platformy oparte na mikrokontrolerach najbardziej rozpowszechnionym sprzętem na rynku. Dzięki niskim kosztom i niskiemu zużyciu energii, mikrokontrolery są idealną platformą, która umożliwia stworzenie inteligentnych urządzeń na brzegu Internetu.

Nawet dużym organizacjom korporacyjnym z dostępem do szeregu naukowców i dużych zbiorów danych oraz zasadniczo nieograniczonym budżetem trudno jest zdobyć biegłość w dziedzinie AI i ML. Dla mniejszych firm może to być po prostu niemożliwe. Jeśli sytuacja pozostanie taka, jaka jest, nie jest możliwe, aby do 2025 roku 25% urządzeń brzegowych zostało uzupełnionych o możliwości AI/ML. Gdyby tylko istniejący twórcy systemów wbudowanych opartych na mikrokontrolerach byli w stanie tworzyć zastosowania AI/ML...

Prosty, szybki i niedrogi sposób na rozwój inteligentnych przedmiotów z wykorzystaniem technologii AI/ML

Najbardziej wszechobecną platformą obliczeniową do zastosowań wbudowanych w środowiskach przemysłowych jest mikrokontroler, a żadne mikrokontrolery nie są powszechniej stosowane niż linia Cortex-M firmy Arm, zwłaszcza modele M0, M0+, M3, M4 i M7.

Ilustracja 1: V2M-MPS2-0318C jest potężną platformą rozwojową dla zastosowań opartych na technologii Arm Cortex-M z dużą ilością wejść/wyjść i wyświetlaczem LCD. (Źródło ilustracji: Arm)

Ilustracja 1: V2M-MPS2-0318C jest potężną platformą rozwojową dla zastosowań opartych na technologii Arm Cortex-M z dużą ilością wejść/wyjść i wyświetlaczem LCD. (Źródło ilustracji: Arm)

Firmy mają dostęp jedynie do tradycyjnych deweloperów wbudowanych systemów. Potrzebny jest jakiś sposób, aby programiści zaczęli działać jak eksperci AI/ML, bez konieczności szkolenia. Idealnym rozwiązaniem byłoby danie tradycyjnym programistom wbudowanych systemów możliwości szybkiego i łatwego tworzenia samoświadomych maszyn, które mogą automatycznie uczyć się i rozumieć swoje środowisko, identyfikować wzorce i wykrywać anomalie, przewidywać problemy i wyniki oraz robić to wszystko na niedrogich platformach opartych na mikrokontrolerach na krawędzi Internetu, gdzie dane są generowane i przechwytywane.

Rozwiązaniem, jak wspomnieliśmy wcześniej, jest NanoEdge AI Studio od Cartesiam.AI. Korzystając z takiego zintegrowanego środowiska programistycznego (IDE), które działa w systemie Windows 10 lub Linux Ubuntu, programista systemów wbudowanych wybiera najpierw docelowy mikrokontroler, Cortex-M0 do M7 firmy Arm. Ponadto, deweloper lub projektant określa maksymalną ilość pamięci RAM, jaka ma być przydzielona do danego rozwiązania. Jeśli Twoje umiejętności nieco zardzewiały lub nie masz jeszcze doświadczenia, dobrze jest zacząć (ponownie) od V2M-MPS2-0318C Arm Cortex-M Prototyping System+ (Rys. 1).

V2M-MPS2-0318C jest częścią linii płytek rozwojowych Arm Versatile Express. Wyposażone są w stosunkowo duże FPGA do tworzenia prototypów projektów opartych na Cortex-M. W tym celu posiadają implementacje szyfrowania w układach FPGA wszystkich procesorów Cortex-M. Posiadają również sporo przydatnych urządzeń obwodowych takich jak PSRAM, Ethernet, ekran dotykowy, ścieżka audio, VGA LCD, SPI i GPIO.

Następnie deweloper musi wybrać liczbę i rodzaj czujników, które mają być wykorzystane - piękno podejścia Cartesiam.AI polega na tym, że nie ma ścisłych ograniczeń dotyczących liczby czujników. Na przykład, mogą one zawierać:

- Przyspieszeniomierze jedno-, dwu- i trzyosiowe (zasadniczo dowolna częstotliwość analizy drgań)

- Czujniki magnetyczne

- Czujniki temperatury

- Mikrofony (do rozpoznawania mowy)

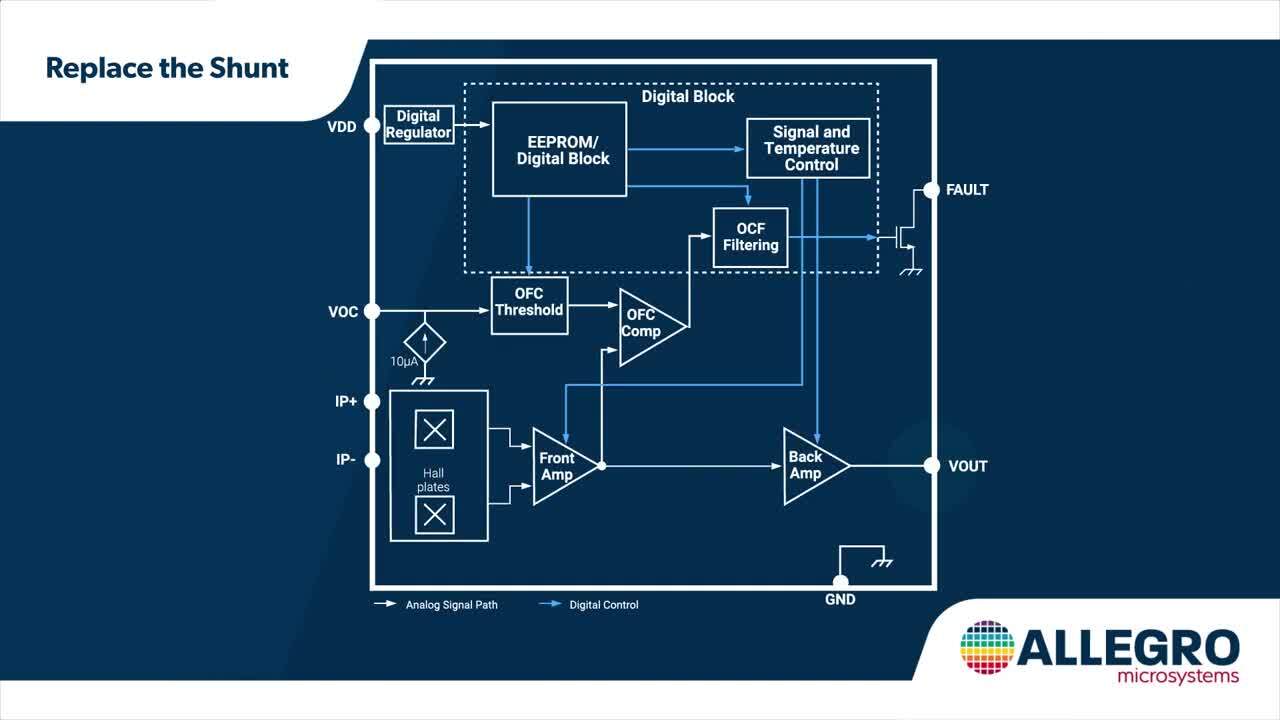

- Czujniki zjawiska Halla do sterowania silnikami

- Czujniki monitorowania prądu

Ważne jest, aby pamiętać, że od dewelopera nie wymaga się definiowania konkretnych numerów katalogowych części - tylko ogólnych typów czujników.

Następnym krokiem jest załadowanie kontekstowych danych z czujników, czyli ogólnych danych związanych z każdym czujnikiem, aby system miał ogólny zarys tego, na czym będzie pracować.

NanoEdge AI Studio jest wyposażone w obszerny pakiet „bloków” AI/ML, które mogą być wykorzystane do tworzenia rozwiązań dla 90% lub więcej zadań przemysłowych z zakresu AI/ML. Po otrzymaniu informacji o docelowym mikrokontrolerze, liczbie i typach czujników oraz ogólnym typie danych z czujników, których może się spodziewać, wygeneruje ono najlepsze rozwiązanie biblioteki AI/ML spośród 500 milionów możliwych kombinacji.

Jeśli deweloper sobie tego życzy, rozwiązanie to może być opcjonalnie przetestowane na tym samym komputerze z uruchomionym NanoEdge AI Studio IDE za pomocą dołączonego emulatora, po czym jest ono osadzane wewnątrz głównego programu mikrokontrolera, skompilowane i pobrane do systemu opartego na tym mikrokontrolerze, który ma być powiązany z maszyną docelową.

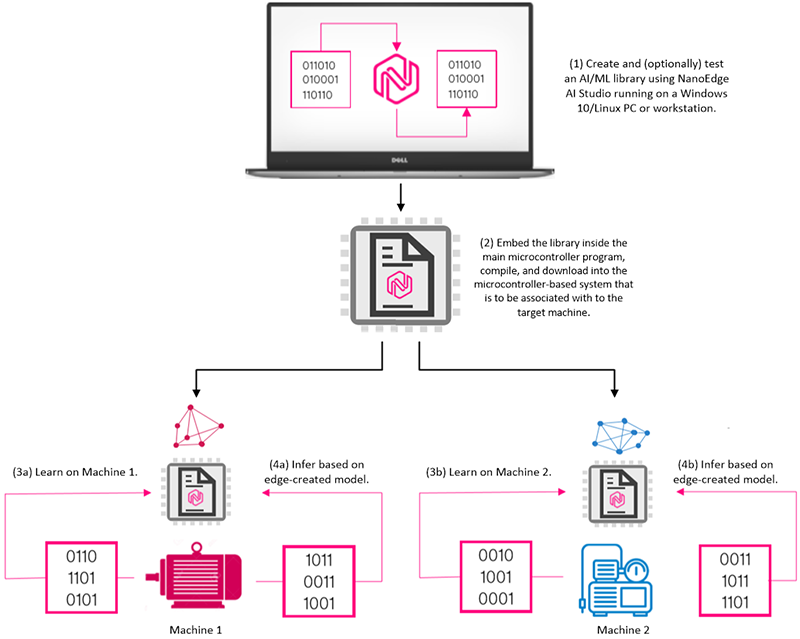

Tylko dla przykładu, załóżmy, że mamy dwie „głupie” maszyny i chcemy, by stały się „inteligentne”. Jedną z tych maszyn może być pompa, a drugą generator. Również dla tego przykładu załóżmy, że tworzymy jedno rozwiązanie wykorzystując czujnik temperatury i trzyosiowy przyspieszeniomierz i że to samo rozwiązanie zostanie zastosowane na obu maszynach (ilustracja 2).

Ilustracja 2: po wykorzystaniu NanoEdge AI Studio IDE do stworzenia i (opcjonalnie) przetestowania biblioteki AI/ML, biblioteka ta jest wbudowywana do głównego programu, kompilowana i pobierana do systemu opartego na tym mikrokontrolerze, który ma być powiązany z maszynami docelowymi. Po fazie nauki (zazwyczaj tydzień pracy przez 24 godziny na dobę), można użyć silnika inferencyjnego do wykrywania i raportowania anomalii oraz przewidywania przyszłych wyników. (Źródło ilustracji: Max Maxfield)

Ilustracja 2: po wykorzystaniu NanoEdge AI Studio IDE do stworzenia i (opcjonalnie) przetestowania biblioteki AI/ML, biblioteka ta jest wbudowywana do głównego programu, kompilowana i pobierana do systemu opartego na tym mikrokontrolerze, który ma być powiązany z maszynami docelowymi. Po fazie nauki (zazwyczaj tydzień pracy przez 24 godziny na dobę), można użyć silnika inferencyjnego do wykrywania i raportowania anomalii oraz przewidywania przyszłych wyników. (Źródło ilustracji: Max Maxfield)

Oczywiście, te dwie maszyny będą miały zupełnie inne charakterystyki działania. W rzeczywistości dwie identyczne maszyny mogą mieć bardzo różne właściwości w zależności od ich lokalizacji i otoczenia. Na przykład dwie identyczne pompy umieszczone w odległości 20 metrów od siebie, znajdujące się w tym samym pomieszczeniu tej samej fabryki mogą wykazywać różne profile wibracyjne w zależności od miejsca ich zamontowania (jedna na betonie, druga nad drewnianymi legarami stropowymi) oraz długości rur (oraz ich kształtów i materiałów ich wykonania), do których są podłączone.

Kluczowym elementem całego procesu jest to, że rozwiązania AI/ML są trenowane indywidualnie na znanych dobrych maszynach, gdzie trening ten trwa zazwyczaj tydzień bez przerwy, 24 godziny na dobę, co pozwala systemowi uczyć się na podstawie wahań temperatury i wzorców wibracji. Dodatkowe sesje mogą oczywiście zostać przeprowadzone w późniejszym terminie w celu dostosowania modeli do zmian środowiskowych związanych z różnymi porami roku (dla zastosowań zewnętrznych) i innych oczekiwanych zmiennych.

Gdy rozwiązania zostaną już „wytrenowane”, mogą zacząć wyciągać wnioski na podstawie wszelkich nowych danych, które się pojawią, identyfikować wzorce i wykrywać anomalie, przewidywać problemy i wyniki oraz przedstawiać swoje wnioski na tablicy rozdzielczej, by możliwa była ich analiza pod kątem technicznym i zarządzania, w zależności od potrzeb.

Podsumowanie

Postrzegam NanoEdge AI Studio jako narzędzie, które ma wpływ na kształt tej branży. Jest ono intuicyjne i pozwoli projektantom systemów wbudowanych wykorzystujących tanie mikrokontrolery Arm Cortex-M o niskiej mocy, wbudowane w miliardy urządzeń na całym świecie, na szybką, łatwą i tanią integrację AI/ML z systemami przemysłowymi. Umożliwi to przekształcenie „głupich” maszyn w maszyny „inteligentne”, co zwiększy ich produktywność i wydajność, jednocześnie umożliwiając wiele oszczędności na kosztach operacyjnych.

Bibliografia:

1: https://www.vxchnge.com/blog/iot-statistics

2: https://securitytoday.com/articles/2020/01/13/the-iot-rundown-for-2020.aspx

3: https://www.helpnetsecurity.com/2019/06/21/connected-iot-devices-forecast/

4: https://securitytoday.com/articles/2020/01/13/the-iot-rundown-for-2020.aspx

5: https://www.kleinerperkins.com/perspectives/the-industrial-awakening-the-internet-of-heavier-things/

6: https://www.ibm.com/downloads/cas/3RL3VXGA

7: https://newsroom.cisco.com/press-release-content?articleId=1847422

8: https://www.idc.com/getdoc.jsp?containerId=US44363318

9: https://www.statista.com/statistics/935382/worldwide-microcontroller-unit-shipments/

Have questions or comments? Continue the conversation on TechForum, DigiKey's online community and technical resource.

Visit TechForum